Преглед моделирања линеарне регресије

Када почнете да учите о алгоритмима машинског учења, започињете учење о различитим начинима алгоритама за МЛ, тј. Супервизирано, ненадзирано, полу надзирано и појачано учење. У овом ћемо се чланку бавити надзираним учењем и једним од основних, а опет моћних алгоритама: Линеарна регресија.

Дакле, надзирано учење је учење у којем тренирамо машину да разуме однос између улазних и излазних вредности дате у скупу података о тренингу, а затим користимо исти модел да предвидимо излазне вредности за скуп података за тестирање. Дакле, у основи, ако имамо излаз или обележавање који су већ наведени у нашем скупу података о тренингу и сигурни смо да пружени излаз има смисла који одговара уносу, тада користимо супервизирано учење. Надзорни алгоритми учења класификовани су у регресију и класификацију.

Регресијски алгоритми се користе када примијетите да је излаз континуирана варијабла, док се алгоритми класификације користе када је излаз подијељен у одјељке као што су Пасс / Фаил, Гоод / Авераге / Бад, итд. Имамо различите алгоритме за извођење регресије или класификације радње са алгоритмом линеарне регресије као основним алгоритмом у регресији.

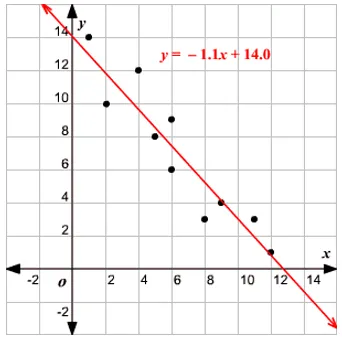

Долазећи до ове регресије, пре него што се упустим у алгоритам, дозволите ми да вам поставим основу. У школовању се надам да се сећате концепта једнаџбе линија. Допустите да вам укратко објасним. Дати су вам две тачке на равнини КСИ, тј. Рецимо (к1, и1) и (к2, и2), где је и1 излаз к1, а и2 је излаз к2, тада је једнаџба линија која пролази кроз тачке (и- и1) = м (к-к1) где је м нагиб линије. Сада, када пронађете једнаџбу правца, ако вам је дата рецимо тачка (к3, и3), лако бисте могли предвидјети да ли тачка лежи на линији или је удаљеност точке од линије. То је била основна регресија коју сам учинио у школовању, а да нисам ни схватио да ће то имати тако велики значај у машинском учењу. Оно што углавном радимо у томе је да покушамо идентифицирати линију једначине или кривуљу која би могла правилно да одговара улазу и излазу скупа података влака, а затим користите исту једначину за предвиђање излазне вредности скупа података испитивања. То би резултирало континуираном жељеном вриједношћу.

Дефиниција линеарне регресије

Линеарна регресија је у ствари врло дуго (око 200 година). То је линеарни модел, тј. Претпоставља линеарни однос између улазних променљивих (к) и једне излазне променљиве (и). И овде се израчунава линеарном комбинацијом улазних варијабли.

Имамо две врсте линеарне регресије

Једноставна линеарна регресија

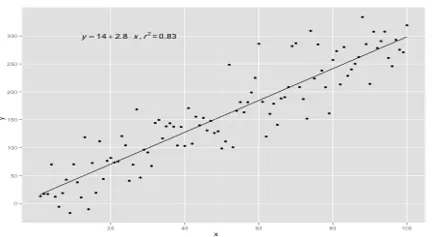

Када постоји једна улазна варијабла, тј. Једначина ретка је ц

сматра се и = мк + ц, онда је то једноставна линеарна регресија.

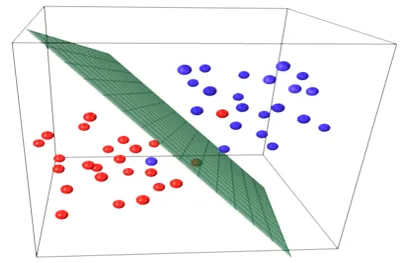

Вишеструка линеарна регресија

Када постоји више улазних варијабли, тј. Једнаџба линија се сматра и = ак 1 + бк 2 +… нк н, тада је то вишеструка линеарна регресија. Различите технике се користе за припрему или тренирање регресијске једнаџбе из података, а најчешћа се назива уобичајеним најмањим квадратима. Модел изграђен наведеном методом назива се редовна регресија најмањих квадрата или само регресија најмањих квадрата. Модел се користи када су улазне вриједности и излазне вриједности које се одређују нумеричке вриједности. Када постоје само један улаз и један излаз, тада је формирана једначина једнака линија, тј

y = B0x+B1

где се коефицијенти линије морају одредити статистичким методама.

Једноставни модели линеарне регресије су веома ретки код МЛ-а јер ћемо у правилу имати различите улазне факторе да одредимо исход. Када постоје више улазних вредности и једна излазна вредност, тада се формира једначина равнине или хипер-равни.

y = ax 1 +bx 2 +…nx n

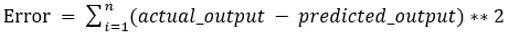

Основна идеја регресијског модела је добити једнаџбу линија која најбоље одговара подацима. Најприкладнија линија је она у којој је укупна грешка предвиђања за све тачке података које се сматрају најмањим могућим. Грешка је удаљеност између тачке на равнини и регресијске линије.

Пример

Кренимо од примера једноставне линеарне регресије.

Однос између висине и тежине особе директно је пропорционалан. Проведено је истраживање на волонтерима како би се утврдило висина и идеална тежина особе и вредности су забележене. То ће се сматрати нашим сетом података о тренингу. Помоћу података о тренингу израчунава се једначина регресијске линије која ће дати минималну грешку. Ова линеарна једнаџба се користи за предвиђање нових података. То јест, ако дамо висину особе, тада одговарајућу тежину треба предвидјети модел који смо развили са минималном или нулту грешком.

Y(pred) = b0 + b1*x

Вриједности б0 и б1 морају бити изабране тако да минимизирају грешку. Ако се сума квадратне грешке узима као метрика за процену модела, тада је циљ да се добије линија која најбоље смањује грешку.

Отклањамо грешку како се позитивне и негативне вредности не би отказале једна другој. За модел са једним предиктором:

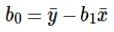

Израчунавање пресретања (б0) у једначини линија врши се према:

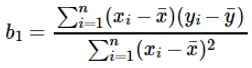

Израчунавање коефицијента за улазну вредност к врши се према:

Разумевање коефицијента б 1 :

- Ако је б 1 > 0, к су (улаз) и и (излаз) директно пропорционални. То је повећање к ће се повећати и као што је повећање висине, повећава се тежина.

- Ако је б 1 <0, тада су к (предиктор) и и (циљ) обрнуто пропорционални. То је повећање к ће се смањити и као што је брзина возила повећава се, смањује се време.

Разумевање коефицијента б 0 :

- Б 0 заузима преосталу вредност за модел и осигурава да предвиђање није пристрасно. Ако немамо Б 0 израз, једначина ретка (и = Б 1 к) је приморана да прође кроз извор, тј. Вредности улаза и излаза стављене у модел резултирају са 0. Али то никада неће бити случај, ако имамо 0 у улазу, тада ће Б 0 бити просек свих предвиђених вредности када је к = 0. Постављање свих вриједности предвиђања на 0 у случају к = 0 резултираће губитком података и често је немогуће.

Поред горе наведених коефицијената, овај модел се може израчунати и користећи нормалне једначине. Даље ћу говорити о употреби нормалних једнаџби и дизајнирању једноставног / мултилинеарног регресијског модела у свом наредном чланку.

Препоручени чланци

Ово је водич за линеарно регресијско моделирање. Овдје смо расправљали о дефиницији, типовима линеарне регресије која укључује једноставну и вишеструку линеарну регресију заједно с неким примјерима. Такође можете погледати следеће чланке да бисте сазнали више -

- Линеарна регресија у Р

- Линеарна регресија у Екцелу

- Предиктивно моделирање

- Како створити ГЛМ у Р?

- Поређење линеарне регресије и логистичке регресије