Питања и одговори за интерно учење дубоког учења

Данас се Дееп Леарнинг сматра једном од најбрже растућих технологија са огромном способношћу развијања апликације која је неко време сматрана тешком. Препознавање говора, препознавање слике, проналажење образаца у скупу података, класификација предмета на фотографијама, стварање текста карактера, аутоматска вожња аутомобила и још много тога само су неколико примјера гдје је Дубоко учење показало своју важност.

Дакле, коначно сте нашли посао из снова у Дееп Леарнинг-у, али се питате како пробити Интервју за дубоко учење и шта би могло бити вероватно Питања о интервјуу за дубоко учење. Сваки интервју је различит и обим посла је такође различит. Имајући то у виду, осмислили смо најчешћа питања и одговоре за дубоко учење како би вам помогли да постигнете успех у свом интервјуу.

Испод је неколико питања о интервјуу дубоког учења која се често постављају у интервјуу и која би такође помогла у тестирању ваших нивоа:

Део 1 - Питања за разговор о дубинском учењу (основна)

Овај први део покрива основна питања и одговоре за дубоко учење

1. Шта је дубоко учење?

Одговор:

Подручје машинског учења које се фокусира на дубоке вештачке неуронске мреже које су слабо инспирисане мозгом. Алексеј Григоревич Ивахненко објавио је прву генералу о делу мреже Дееп Леарнинг. Данас се примењује у разним областима као што су рачунарски вид, препознавање говора, обрада природног језика.

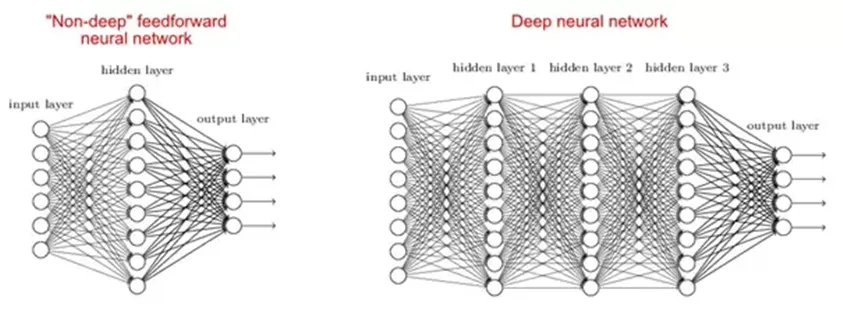

2. Зашто су дубоке мреже боље од плитких?

Одговор:

Постоје студије које кажу да се и плитке и дубоке мреже могу уклопити у било коју функцију, али како дубоке мреже имају неколико скривених слојева често различитих врста, тако да су у стању да изграде или извуку боље карактеристике од плитких модела са мање параметара.

3. Која је функција трошкова?

Одговор:

Функција трошкова је мерило тачности неуронске мреже у односу на дати узорак тренинга и очекивани излаз. То је једна вредност, невектор, јер даје перформансе неуронске мреже у целини. Може се израчунати испод функције Средња квадратна грешка: -

МСЕ = 1н∑и = 0н (И и – Ии) 2

Где је И и жељена вредност И је оно што желимо да смањимо.

Идемо на следећа питања за интервју о дубоком учењу.

4. Шта је градијентно спуштање?

Одговор:

Спуштање градијента у основи је алгоритам оптимизације, који се користи за учење вредности параметара који минимизирају функцију трошкова. То је итеративни алгоритам који се креће у правцу најбржег спуштања како је дефинисано негацијом градијента. Израчунавамо пад градијента функције трошка за одређени параметар и ажурирамо параметар доле наведеном формулом: -

Θ: = Θ – αд∂ΘЈ (Θ)

Где је Θ - параметар вектор, α - стопа учења, Ј (Θ) - функција трошкова.

5. Шта је повратно ширење?

Одговор:

Повратак ширења је алгоритам тренинга који се користи за вишеслојну неуронску мрежу. У овој методи премештамо грешку са краја мреже на све тежине унутар мреже и на тај начин омогућавамо ефикасно рачунање градијента. Може се поделити на неколико корака на следећи начин:

Прелазно ширење података о обуци ради стварања резултата.

ХенТада помоћу циљне вредности и деривата грешке излазне вредности може се израчунати с обзиром на активацију излаза.

Затим креирамо бацкуп за рачунање деривата грешке у односу на излазну активацију на претходном и настављамо ово за све скривене слојеве.

Синг Употребом претходно израчунатих деривата за излаз и свих скривених слојева израчунавамо деривате грешака у односу на тежине.

А затим ажурирамо утеге.

6. Објасните следеће три варијанте пада градијента: шаржа, стохастика и мини серија?

Одговор:

Стохастички силазни градијент : Овде користимо само један пример тренинга за израчунавање градијентних параметара и ажурирања параметара.

Батцх Градиент Десцент : Овде израчунавамо градијент за читав низ података и извршимо ажурирање при свакој итерацији.

Мини-батцх Градиент Десцент : То је један од најпопуларнијих алгоритама за оптимизацију. То је варијанта Стохастиц Градиент Десцент и овде се уместо појединачног примера тренинга користи мини-серија узорака.

Део 2 - Питања за интервју дубоког учења (напредно)

Погледајмо сада напредна питања за интервју о дубоком учењу.

7. Које су предности спуштања минијатурним градијентом?

Одговор:

Испод су предности мини спуштања са градијентом

• Ово је ефикасније у поређењу са стохастичким градијентом.

• генерализација проналажењем равних минима.

• Мини серије омогућавају помоћ при приближавању нагиба целог сета тренинга, што нам помаже да избегнемо локалне минимале.

8. Шта је нормализација података и зашто су нам потребни?

Одговор:

Нормализација података користи се за време ширења података. Главни мотив нормализације података је смањење или уклањање сувишних података. Овде поново скалирамо вредности како бисмо се уклопили у одређени распон да бисмо постигли бољу конвергенцију.

Идемо на следећа питања за интервју о дубоком учењу.

9. Шта је иницијализација тежине у неуронским мрежама?

Одговор:

Иницијализација тежине је један од веома важних корака. Лоша иницијализација тежине може спречити мрежу да учи, али добра иницијализација тежине помаже у бржој конвергенцији и бољој укупној грешци. Предрасуде се генерално могу иницијализирати на нулу. Правило за подешавање тегова је да буде близу нули, а да није премало.

10. Шта је ауто-кодер?

Одговор:

Аутоенкодер је аутономни алгоритам машинског учења који користи принцип повратног ширења, при чему су постављене циљне вредности једнаке унесеним уносима. Интерно има скривени слој који описује код који се користи за представљање улаза.

Неке су кључне чињенице о аутоенкодеру следеће:

• То је неодржавани алгоритам МЛ сличан анализи главних компоненти

• Минимизира исту циљну функцију као и анализа главних компоненти

• То је неуронска мрежа

• Циљни излаз неуронске мреже је њен улаз

11. Да ли је у реду повезивање са излаза Лаиер 4 на улаз Лаиер 2?

Одговор:

Да, то се може учинити с обзиром да је излазни слој 4 из претходног временског корака као у РНН-у. Такође, морамо претпоставити да је претходна улазна серија понекад корелирана са тренутном партијом.

Идемо на следећа питања за интервју о дубоком учењу.

12. Шта је Болтзманнова машина?

Одговор:

Болтзманнова машина користи се за оптимизацију решења проблема. Рад Болтзманнове машине је у основи оптимизација тежине и количине задатог проблема.

Неке важне тачке о Болтзманновој машини -

• Користи понављајућу структуру.

• Састоји се од стохастичних неурона, који се састоје од једног од два могућа стања, било 1 или 0.

• неурони у овом су или у адаптивном (слободном стању) или стегнутом (смрзнуто).

• Ако применимо симулирано жарење на дискретној Хопфиелд мрежи, то би постало Болтзманнова машина.

13. Која је улога функције активације?

Одговор:

Функција активације користи се за увођење нелинеарности у неуронску мрежу помажући јој да научи сложеније функције. Без које би неуронска мрежа могла да научи само линеарну функцију која је линеарна комбинација његових улазних података.

Препоручени чланци

Ово је водич за листу питања и одговора за интервју дубоког учења како би кандидат могао лако да разбије ова питања о интервјуу за дубоко учење. Такође можете погледати следеће чланке да бисте сазнали више

- Сазнајте 10 најбољих корисних питања о интервјуу за ХБасе

- Питања и одговори за корисно машинско учење и интервју

- Топ 5 највреднијих питања о интервјуу за науку о подацима

- Важна Руби питања и одговори за разговор