Увод у паковање и појачавање

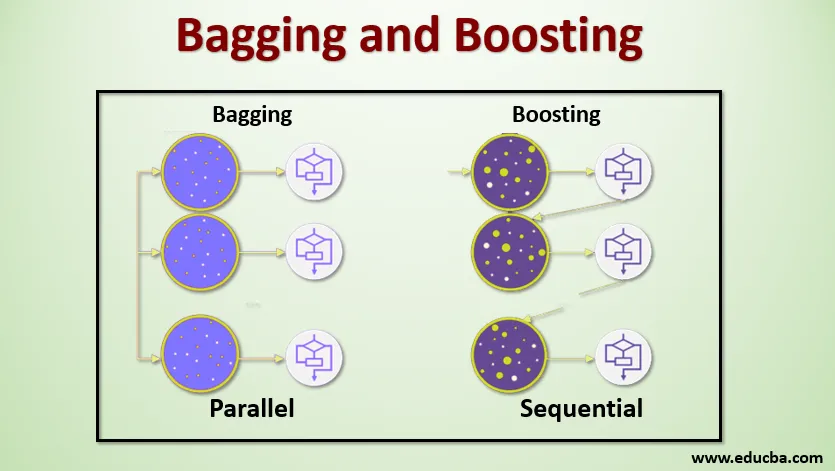

Двије и популарне методе су два популарна метода ансамбла. Дакле, пре него што схватимо баговање и подстицање, нека има идеју о томе шта је ансамбл Учење. То је техника за коришћење више алгоритама учења за обуку модела са истим подацима да би се добило предвиђање у машинском учењу. Након добијања предвиђања из сваког модела, користићемо технике просечења модела као што су пондерисани просек, варијанца или максимално гласање да бисмо добили коначно предвиђање. Ова метода има за циљ да добије боље прогнозе од појединачних модела. То резултира бољом тачношћу избегавајући прекомерно уклапање и смањује пристраност и ко-разлике. Две популарне методе ансамбла су:

- Торба (агрегирање)

- Појачавање

Торба:

Прекривање, познато и под називом Боотстрап Аггрегатинг, користи се за побољшање тачности и чини модел генерализованијим смањујући варијанцу, тј. Избегавајући прекомерно уклапање. У овом случају узимамо више подскупова базе података о тренингу. За сваки подскуп, узимамо модел са истим алгоритмима учења као што су стабло одлука, логистичка регресија итд. За предвиђање резултата за исти скуп тестних података. Једном када имамо предвиђање за сваки модел, тада користимо технику просечења модела да бисмо добили коначни излаз предвиђања. Једна од познатих техника која се користи у багању је Рандом Форест . У Рандом шуми користимо више стабала одлука.

Појачавање :

Потицање се првенствено користи да би се смањила пристраност и одступање у контролираној техници учења. Односи се на породицу алгоритама који слабе ученике (основни ученик) претвара у снажне ученике. Слаби ученик су класификатори који су у незнатној мери тачни само са стварном класификацијом, док су јаки полазници класификатори који су добро повезани са стварном класификацијом. Неколико познатих техника појачавања су АдаБоост, ГРАДИЕНТ БООСТИНГ, КсгБООСТ (Ектреме Градиент Боостинг). Дакле, сада знамо шта су пакирање и потицање и које су њихове улоге у Машинском учењу.

Израда врећа и подметања

Сада да разумемо како функционира пакирање и подметање:

Торба

Да бисмо разумели рад Багинг-а, претпоставимо да имамо Н број модела и скуп података Д. Где је м број података, а н је број карактеристика у сваком подацима. И требало би да урадимо бинарну класификацију. Прво ћемо поделити скуп података. За сада ћемо поделити овај скуп података само на тренинг и тест сет. Назовимо скуп података о тренингу као место где је укупан број примера тренинга.

Узмите узорак записа из тренинг групе и користите га за тренирање првог модела рецимо м1. За следећи модел, м2 поново прилагодите сет за тренинг и узмите још један узорак из тренинг-сета. То ћемо учинити за Н број модела. Пошто реорганизујемо скуп података тренинга и узимамо узорке из њега, а да ништа не уклонимо из скупа података, можда је могуће да имамо два или више записа података о тренингу који су заједнички у више узорака. Ова техника поновног прилагођавања скупа података о тренингу и пружање узорка моделу названа је као узорковање реда са замјеном. Претпоставимо да смо обучили сваки модел и сада желимо да видимо предвиђање тестних података. Будући да радимо на излазу бинарне класификације може бити или 0 или 1. Теста података прелази се на сваки модел, а од сваког модела добијамо предвиђање. Рецимо да је од Н модела више од Н / 2 модела предвиђало да ће бити 1, Дакле, користећи технику просечења модела попут максималног гласања, можемо рећи да је предвиђени излаз за тестне податке 1.

Појачавање

Појачавањем узимамо записе из скупа података и преносимо их темељним ученицима, овдје основни полазници могу бити било који модел. Претпоставимо да имамо м број записа у скупу података. Затим просљеђујемо неколико записа базном учењу БЛ1 и тренирамо га. Једном када се БЛ1 оспособи, онда просљеђујемо све записе из скупа података и видимо како Басе полазник функционише. За све записе које је основни ученик погрешно класификовао, само их узимамо и просљеђујемо другом ученику, рецимо БЛ2, и истовремено преносимо погрешне записе класифициране од стране БЛ2 да би тренирали БЛ3. То ће се наставити осим ако и док не одредимо одређени број основних модела ученика који су нам потребни. Коначно, комбинујемо излаз из ових базних ученика и стварамо снажног ученика, што резултира побољшањем снаге предвиђања модела. Ок. Дакле, сада знамо како функционирају бакинг и јачање.

Предности и недостаци кеса и потицања

У наставку су наведене главне предности и недостаци.

Предности врећице

- Највећа предност паковања је да више слабих ученика може боље радити од једног јаког ученика.

- Омогућава стабилност и повећава тачност алгоритма машинског учења који се користи у статистичкој класификацији и регресији.

- Помаже у смањењу одступања, тј. Избегава прекомерно уклапање.

Недостаци вреће

- То може довести до велике пристраности ако се не моделира правилно и на тај начин може резултирати недовољним задовољавањем.

- Будући да морамо да користимо више модела, рачунски постаје скупо и можда неће бити погодан у разним случајевима употребе.

Предности подстицања

- То је једна од најуспешнијих техника за решавање проблема двоструке класификације.

- Добро је руковати недостајућим подацима.

Недостаци појачања

- Појачавање је тешко реализовати у реалном времену због повећане сложености алгоритма.

- Велика флексибилност ове технике резултира с вишеструким бројем параметара него што имају директан утицај на понашање модела.

Закључак

Главни потез је да је баговање и јачање парадигма машинског учења у којој користимо више модела да бисмо решили исти проблем и постигли боље перформансе. Ако правилно комбинујемо слабе ученике, тада можемо добити стабилан, тачан и робустан модел. У овом сам чланку дао основни преглед врећице и подметања. У наредним чланцима упознаћете различите технике које се користе у оба. За крај ћу закључити подсећањем да су баговање и јачање међу најкоришћенијим техникама учења ансамбла. Права уметност побољшања перформанси лежи у вашем разумевању када треба користити који модел и како подесити хиперпараметре.

Препоручени чланци

Ово је водич за паковање и подметање. Овде смо расправљали о Уводу у кресање и јачање и ради заједно са предностима и недостацима. Можете и да прођете кроз друге наше предложене чланке да бисте сазнали више -

- Увод у ансамбл технике

- Категорије алгоритама машинског учења

- Алгоритам за јачање градијента са кодом узорка

- Шта је појачани алгоритам?

- Како креирати стабло одлука?