Увод у Кернел методе у машинском учењу

Алгоритам који се користи за анализу образаца назива се Кернел методом у машинском учењу. У општем обрасцу, анализа се врши како би се пронашли односи у скуповима података. Ови односи могу бити кластерирање, класификација, главне компоненте, корелација итд. Већина ових алгоритама који решавају ове задатке анализе обрасца, Потребни су подаци у сировом репрезентативцу, да би били изричито трансформисани у репрезентативни векторски приказ. Ова трансформација се може обавити путем корисничке мапе карактеристика. Дакле, може се узети да је кернел методом потребан само кернел који је одредио корисник.

Терминологија Кернал метода произлази из чињенице да они користе функцију кернела, која им омогућава да обављају операцију у високим димензионалним, имплицитним простором карактеристика, без потребе за рачунањем координата података у том простору. Уместо тога, они једноставно израчунавају унутрашњи производ између слика свих парова података у простору функција.

Ове врсте операција су рачунски јефтиније већину времена у поређењу са експлицитним израчунавањем координата. Ова техника се назива "кернел трик". Било који линеарни модел може се претворити у нелинеарни модел применом кернел трика на модел.

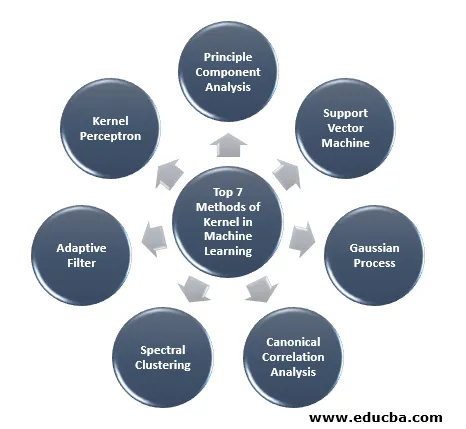

Кернел метода доступна у машинском учењу је анализа главних компоненти (ПЦА), спектрално групирање, векторске машине за подршку (СВМ), каноничка корелацијска анализа, перцептрон језгре, Гаусови процеси, регресија гребена, линеарни прилагодљиви филтри и многи други. Разумејмо неколико ових кернел метода.

Топ 7 метода језгре у машинском учењу

Ево метода Кернел у машинском учењу које се спомињу у наставку:

1. Анализа принципа компонената

Анализа главних компоненти (ПЦА) је техника за вађење структуре из већих димензија података. Лако се изводи помоћу итеративних алгоритама који процењују главне компоненте или решавањем проблема својствене вредности. ПЦА је ортогонална трансформација координатног система у којој описујемо наше податке. Нови координатни систем добија се пројекцијом на главне осе података. Мали број главних компоненти често је довољан да се обухвати највећи део структуре у подацима. Једна од његових главних примена је вршење истраживачких података за израду предиктивног модела. Најчешће се користи за визуелизацију повезаности између популација и генетске дистанце.

2. Подршка векторска машина

СВМ се може дефинисати као класификатор за раздвајање хиперплана где је хиперплана подпростор једне димензије мањи од амбијенталног простора. Димензија овог математичког простора је дефинисана као минимални број координата потребних за спецификацију било које тачке, док је амбијентални простор простор који окружује математички објект. Сада се математички објект може схватити као апстрактни објект који не постоји ни у једном тренутку или на месту већ постоји као врста ствари.

3. Гауссов процес

Гаусов процес назван је по Карку Фриедрицха Гауссу јер користи ознаку Гауссове дистрибуције (нормална дистрибуција). То је стохастички процес који значи скуп случајних променљивих индексираних временом или простором. У Гауссовом процесу случајне променљиве имају мултиваријантну нормалну дистрибуцију, тј. Све коначне линеарне комбинације су нормално дистрибуиране. Гауссов процес користи својства наслијеђена из нормалне дистрибуције и због тога су корисна у статистичком моделирању. Алгоритам машинског учења који укључује ову методу кернела користи меру лењог учења и сличности између тачака да би предвидио вредност невидљивих поена из података о тренингу. Ово предвиђање није само процена већ и неизвесност у том тренутку.

4. Каноничка корелациона анализа

Каноничка корелациона анализа је начин изношења информација из унакрсних коваријантских матрица. Позната је и као каноничка анализа варијабли. Претпоставимо да имамо два вектора Кс, И случајне променљиве рецимо два вектора Кс = (Кс1, …, Ксн) и вектор И = (И1, …, Им), а променљива која има корелацију, тада ће ЦЦА израчунати линеарну комбинацију Кс и И који имају максималну повезаност једни с другима.

5. Спектрално кластерирање

У примени сегментације слике, спектрално групирање познато је као категоризација објеката заснована на сегментацији. У спектралном кластерирању смањује се димензионалност пре кластерирања у мањој димензији, а то се користи коришћењем својствене вредности матрице сличности података. Има своје коријене у теорији графова, гдје се овај приступ користи за идентифицирање заједница чворова у графу који се заснива на ивицама које их повезују. Ова метода је довољно флексибилна и омогућава нам да групирамо податке и из не-графа.

6. Адаптивни филтер

Прилагодљиви филтер користи линеарни филтер који садржи функцију преноса, која се контролише променљивим параметрима и методама, а које ће се користити за подешавање ових параметара према алгоритму оптимизације. Сложеност овог алгоритма за оптимизацију је разлог што је сав адаптивни филтер дигитални филтер. Прилагодљиви филтер потребан је у оним апликацијама где унапред нема информација о жељеном поступку обраде или се они мењају.

Функција трошка користи се у адаптивном филтеру затворене петље, јер је неопходна за оптималне перформансе филтера. Одређује како да промените функцију преноса филтра како би смањили трошкове следеће итерације. Једна од најчешћих функција је средња квадратна грешка сигнала грешке.

7. Кернел Перцептрон

У машинском учењу, перцептрон кернела је врста популарног алгоритма за учење перцептрона који може да научи језгрене машине, као што су нелинеарни класификатори који користе функцију кернела за израчунавање сличности узорака који нису видљиви узорцима тренинга. Овај алгоритам је изумљен 1964. године, што га чини првим учеником класификације кернела.

Већина расправљених алгоритама језгре заснива се на конвексној оптимизацији или властитим проблемима и статистички је добро утемељена. Њихова статистичка својства анализирају се помоћу теорије статистичког учења.

Говорећи о областима примене кернел метода, они су различити и укључују геостатистику, кригинг, инверзно пондерисање, 3Д реконструкцију, биоинформатику, хемоинформатику, вађење информација и препознавање рукописа.

Закључак

Сажео сам неке од терминологија и врста кернел метода у Машинском учењу. Због недостатка простора, овај чланак никако није свеобухватан и само вам треба пружити разумевање шта је метода кернела и кратак резиме њихових врста. Међутим, покривање овог чланка натераће вас да учините први корак на пољу машинског учења.

Препоручени чланци

Ово је водич за Кернел метод у машинском учењу. Овде смо расправљали о 7 врста Кернел метода у машинском учењу. Такође можете погледати следећи чланак.

- Монолитна језгра

- Кластерирање у машинском учењу

- Дата Сциенце Мацхине Леарнинг

- Ненадзоровано машинско учење

- ПХП Филтери | Како потврдити унос корисника помоћу разних филтера?

- Комплетан водич за животни циклус машинског учења