Шта је линеарна регресија у Р?

Линеарна регресија је најпопуларнији и широко кориштен алгоритам у области статистике и машинског учења. Линеарна регресија је техника моделирања која разуме однос између улазних и излазних променљивих. Овде променљиве морају бити нумеричке. Линеарна регресија долази из чињенице да је излазна варијабла линеарна комбинација улазних варијабли. Излаз је обично представљен са "и", док је улаз представљен са "к".

Линеарна регресија у Р може се категорисати на два начина

-

Си мпле линеарна регресија

Ово је регресија у којој је излазна варијабла функција једне улазне варијабле. Приказ једноставне линеарне регресије:

и = ц0 + ц1 * к1

-

Вишеструка линеарна регресија

Ово је регресија где је излазна варијабла функција вишеструке улазне променљиве.

и = ц0 + ц1 * к1 + ц2 * к2

У оба горња случаја ц0, ц1, ц2 су коефицијенти који представљају регресијске тежине.

Линеарна регресија у Р

Р је веома моћно статистичко средство. Па да видимо како се линеарна регресија може извести у Р и како се могу интерпретирати њене излазне вредности.

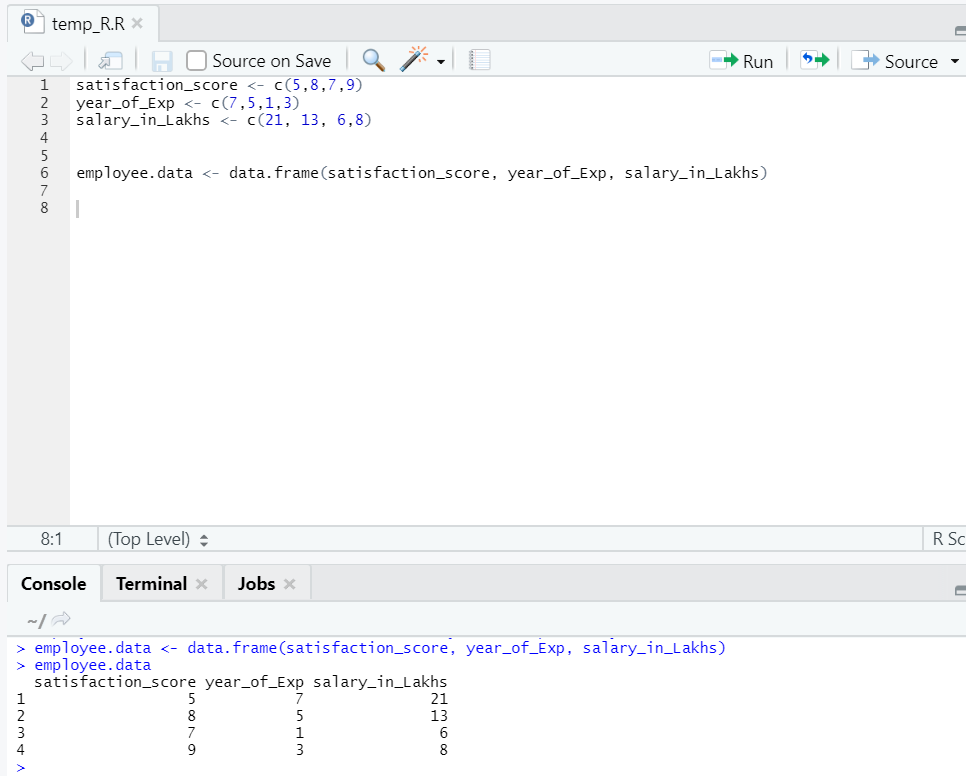

Припремимо скуп података, који ће сада дубински извести и разумети линеарну регресију.

Сада имамо скуп података, где су „задовољство_сцоре“ и „иеар_оф_Екп“ независна променљива. „Плате_ин_лакхс“ је излазна променљива.

Позивајући се на горњи скуп података, проблем који желимо овде да решимо линеарном регресијом је:

Процена плате запосленог на основу године искуства и задовољства у компанији.

Р код линеарне регресије:

model <- lm(salary_in_Lakhs ~ satisfaction_score + year_of_Exp, data = employee.data)

summary(model)

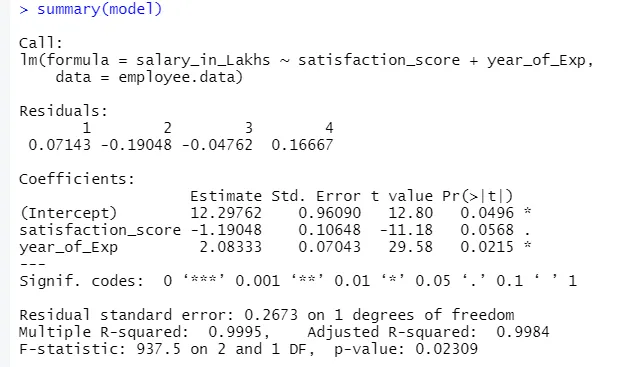

Излаз горњег кода биће:

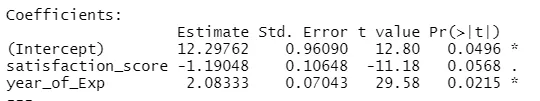

Формула регресије постаје

И = 12, 29-1, 19 * задовољство_сцоре + 2, 08 × 2 * година_оф_Екп

У случају да један има више улаза у модел.

Тада Р код може бити:

модел <- лм (плате_ин_Лакхс ~., подаци = запослени.дата)

Међутим, ако неко жели да изабере променљиву из више улазних променљивих, на располагању су више техника као што су „Назад елиминација“, „Напредни избор“ итд.

Тумачење линеарне регресије у Р

Испод су неке интерпретације линеарне регресије у р које су следеће:

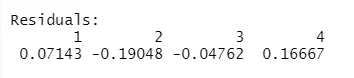

1.Ресидуалс

Ово се односи на разлику између стварног одговора и предвиђеног одговора модела. Дакле, за сваку тачку биће један стварни одговор и један предвиђени одговор. Дакле, остатака ће бити онолико колико има и опажања. У нашем случају имамо четири запажања, дакле четири резидуала.

2.Коефицијенти

Даље ћемо пронаћи дио коефицијената који приказује пресретање и нагиб. Ако желите да предвидите плату запосленог на основу његовог искуства и задовољства, потребно је развити моделну формулу засновану на нагибу и пресретању. Ова формула ће вам помоћи у предвиђању плате. Прекидач и нагиб помажу аналитичару да смисли најбољи модел који најбоље одговара тачкама података.

Нагиб: приказује стрму линију.

Пресретање: локација на којој линија пресече оси.

Да разумемо како се формира формула на основу нагиба и пресретања.

Реците да је пресретање 3, а нагиб 5.

Дакле, формула је и = 3 + 5к . То значи ако је к повећан за јединицу, и постаје повећан за 5.

а.Кеефицијент - процена

У овом, пресретање означава просечну вредност излазне променљиве, када сав улаз постане нула. Дакле, у нашем случају, плата у лаксима ће бити 12, 29 Лакс као просјек с обзиром на резултат задовољства и искуство долази на нулу. Овдје нагиб представља промјену излазне варијабле с промјеном јединице у улазној варијабли.

б.коефицијент - Стандардна грешка

Стандардна грешка је процена грешке коју можемо добити приликом израчунавања разлике између стварне и предвиђене вредности наше променљиве одговора. Заузврат, ово говори о поверењу за повезивање улазних и излазних променљивих.

ц.коефицијент - т вредност

Ова вредност даје поверење да одбаци нулту хипотезу. Што је већа вредност од нуле, то је већа поузданост за одбацивање нулте хипотезе и успостављање односа између излазне и улазне варијабле. И у нашем случају вредност је такође једнака нули.

д.Коефицијент - Пр (> т)

Овај акроним у основи приказује п-вредност. Што се ближи нули, лакше ћемо одбацити ништавну хипотезу. Црта коју видимо у нашем случају, та вредност је близу нуле, можемо рећи да постоји веза између пакета плата, степена задовољства и године искуства.

Преостала стандардна грешка

Ово приказује грешку у предвиђању променљиве одговора. Што је нижа, већа је тачност модела.

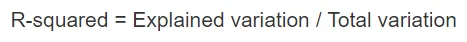

Вишеструки Р-квадрат, Прилагођени Р-квадрат

Р-квадрат је веома важна статистичка мера за разумевање колико су се подаци приближили моделу. Отуда у нашем случају колико добро наш модел који има линеарну регресију представља скуп података.

Вредност Р-квадрата увек лежи између 0 и 1. Формула је:

Што се вредност ближи 1, модел боље описује скупове података и њену варијанцу.

Међутим, када на слику дође више од једне улазне променљиве, преферирана је подешена вредност Р квадрата.

Ф-статистика

То је снажна мера за утврђивање односа између улазне и променљиве одговора. Што је већа вредност од 1, већа је и поузданост у однос између улазне и излазне варијабле.

У нашем случају „937.5“, што је релативно веће с обзиром на величину података. Отуда одбацивање ништавне хипотезе постаје лакше.

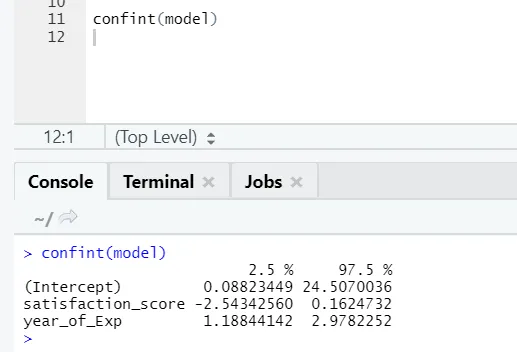

Ако неко жели да види интервал поузданости за коефицијенте модела, ево начина за то: -

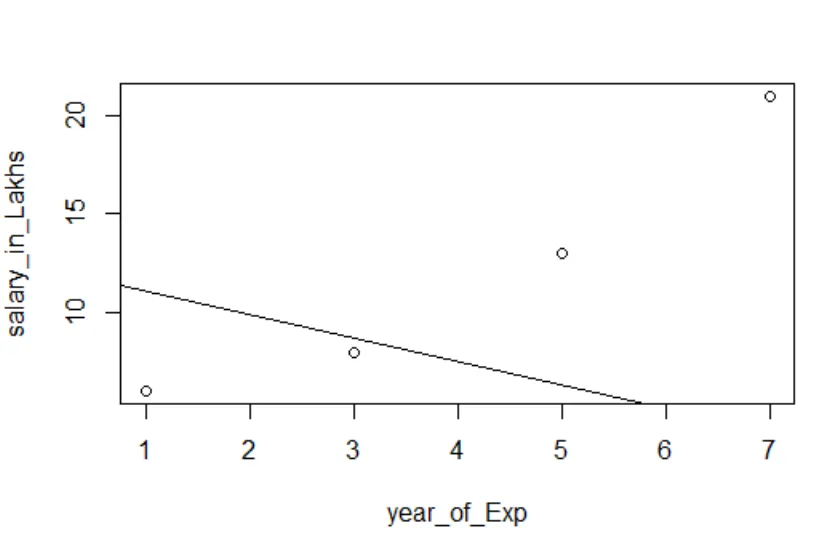

Визуализација регресије

Р Код:

парцела (плате_ин_Лакхс ~ задовољство_сцоре + година_од_Екп, подаци = запослени.податци)

аблине (модел)

Увек је боље прикупити све више и више бодова, пре него што се уклапа у модел.

Закључак - Линеарна регресија у Р

Линеарна регресија је једноставан, лаган за постављање, лако разумљив, а опет врло моћан модел. Видели смо како се линеарна регресија може извести на Р. Такође смо покушали да протумачимо резултате, што вам може помоћи у оптимизацији модела. Једном када се опустите једноставном линеарном регресијом, треба испробати вишеструку линеарну регресију. Упоредо са тим, како је линеарна регресија осетљива на одметнике, мора се погледати у њу, пре него што директно ускочите у фитину до линеарне регресије.

Препоручени чланци

Ово је водич за Линеарну регресију у Р. Овде смо разговарали о томе шта је линеарна регресија у Р? категоризација, визуализација и интерпретација Р. Такође можете да прођете кроз остале предложене чланке да бисте сазнали више -

- Предиктивно моделирање

- Логистичка регресија у Р

- Дрво одлуке у Р

- Р Интервју питања

- Главне разлике регресије и класификације

- Водич за стабло одлука у машинском учењу

- Линеар Регрессион вс Логистиц Регрессион | Топ разлике