Преглед функција губитака у машинском учењу

Баш као што нас учитељи воде, без обзира да ли у нашем академику радимо добро или не, функције губитка раде исти посао. То је метода процене колико добро наш алгоритам моделира податке. Функције губитака су главни извор процене у савременом машинском учењу. Када промените алгоритам како бисте побољшали свој модел, вредност функције губитка ће вам рећи да ли напредујете или не. Наш примарни циљ требало би да буде смањење функције губитака оптимизацијом. У овом ћемо чланку говорити о начину функционисања губитака и различитим врстама губитничких функција.

Како функционишу функције губитка?

Реч "Губитак" наводи казну због неуспеха у постизању очекиваног резултата. Ако је одступање предвиђене вредности од очекиване вредности по нашем моделу велико, тада функција губитка даје већи број као излаз, а ако је одступање мало и много је ближе очекиваној вредности, емитује мањи број.

Ево примера када покушавамо да предвидимо продајне цене кућа у градовима метроа.

| Предвиђено

Продајна цена (у лакх) | Заправо

Продајна цена (у лакх) | Одступање (губитак) |

| Бангалор: 45 | 0 (Сва предвиђања су тачна) | |

| Пуне: 35 | ||

| Ченај: 40 | ||

| Бангалор: 40 | Бангалор: 45 | 5 лакх за Бангалоре, 2 лакх за Цхеннаи |

| Пуне: 35 | Пуне: 35 | |

| Ченај: 38 | Ченај: 40 | |

| Бангалор: 43 | 2 лака за Бангалор, 5 лакх за, Пуне2 лакх за Ченај, | |

| Пуне: 30 | ||

| Ченај: 45 |

Важно је напоменути да количина одступања није битна, оно што је овде важно јесте да ли је вредност предвиђена нашим моделом тачна или погрешна. Функције губитка разликују се на основу ваше изјаве проблема на коју се примењује машинско учење. Функција трошкова је још један појам, који се наизменично користи за функцију губитака, али има нешто другачије значење. Функција губитака је за један пример тренинга, док је функција трошкова просечни губитак у целокупном скупу влакова.

Врсте функција губитака у машинском учењу

Испод су различите врсте губитака у машинском учењу које су следеће:

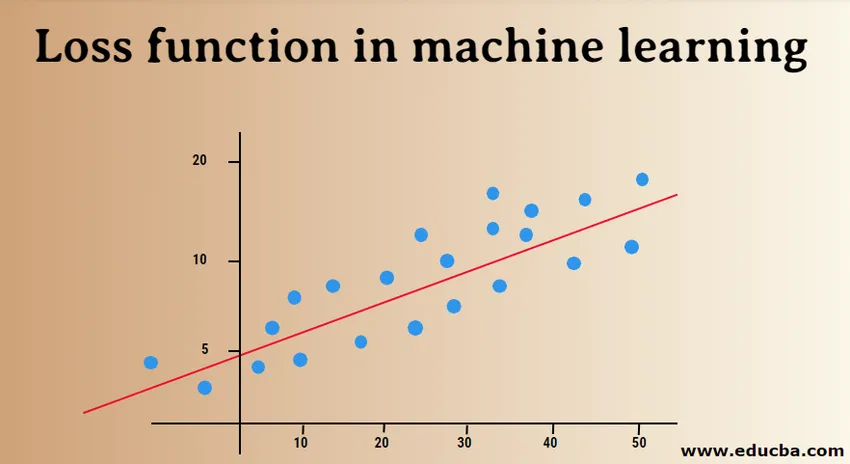

1) функције регресијског губитка:

Линеарна регресија је основни концепт ове функције. Функције губитка регресије успостављају линеарни однос између зависне променљиве (И) и независне променљиве (Кс), стога покушавамо да уклопимо најбољу линију у простору на ове променљиве.

И = Кс0 + Кс1 + Кс2 + Кс3 + Кс4…. + Ксн

Кс = независне променљиве

И = зависна променљива

- Средњи губитак грешке у квадрату:

МСЕ (грешка Л2) мери просечну квадратну разлику између стварних и предвиђених вредности према моделу. Излаз је један број повезан са скупом вредности. Наш циљ је смањити МСЕ да би се побољшала тачност модела.

Узимајући у обзир линеарну једначину, и = мк + ц, МСЕ можемо извести као:

МСЕ = 1 / Н ∑и = 1 до н (и (и) - (мк (и) + б)) 2

Овде је Н укупни број тачака података, 1 / Н ∑и = 1 до н је средња вредност, а и (и) стварна вредност, а мк (и) + б његова предвиђена вредност.

- Средњи логаритамски губитак грешке (МСЛЕ):

МСЛЕ мери однос између стварне и предвиђене вредности. Уводи асиметрију у кривуљу грешке. МСЛЕ брине само проценат разлике стварних и предвиђених вредности. Може бити добар избор као функција губитка, када желимо предвидјети продајне цијене кућа, продајне цијене пекара и подаци су континуирани.

Овде се губитак може израчунати као средина посматраних података квадратних разлика између лог-трансформисаних стварних и предвиђених вредности, које се могу дати као:

Л = 1нн∑и = 1 (лог (и (и) +1) −лог (и (и) +1)) 2

- Средња апсолутна грешка (МАЕ):

МАЕ израчунава суму апсолутних разлика између стварних и предвиђених променљивих. То значи да мери просечну јачину грешака у скупу предвиђених вредности. Коришћење средње квадратне грешке лакше је решити, али употреба апсолутне грешке је робуснија за одласке. Одличне вредности су оне вредности које изузетно одступају од осталих опажених тачака података.

МАЕ се може израчунати као:

Л = 1нн∑и = 1∣∣и (и) - и (и) ∣∣

2) Функције губитка бинарне класификације:

Ове функције губитака направљене су за мерење перформанси класификационог модела. При томе се тачкама података додјељује једна од ознака, тј. 0 или 1. Даље, могу се класификовати као:

- Бинарна унакрсна ентропија

То је подразумевана функција губитка за проблеме бинарне класификације. Крос-ентропијски губитак израчунава перформансе класификацијског модела који даје вредност вредности вероватноће између 0 и 1. Погрешки ентропије губитак расте како предвиђена вредност вероватноће одступа од стварне ознаке.

- Губитак зглоба

Губитак зглобова може се користити као алтернатива унакрсној ентропији, која је првобитно развијена за употребу са алгоритмом векторске машине за подршку. Губитак шарки најбоље функционише код проблема са класификацијом јер су циљне вредности у сету од (-1, 1). Омогућује додвајање више грешака када постоји разлика у знаку између стварних и предвиђених вриједности. То резултира бољим перформансама од унакрсне ентропије.

- Губитак зглоба у квадрату

Проширење губитка шарке, који се једноставно израчунава квадратом губитка шарке. Смањује функцију грешке и чини је нумерички лакшом за рад. Проналази границу класификације која одређује максималну маржу између тачака података различитих класа. Губитак шарки у квадрату савршено одговара ДА или НЕ проблемима са одлуком, при чему одступање вероватноће није проблем.

3) Функције губитка класификације у више класа:

Класификација у више класа су предиктивни модели у којима су податковне тачке додијељене више од двије класе. Свакој класи се додељује јединствена вредност од 0 до (Број_оф_класа - 1). Веома се препоручује због проблема са класификацијом слика или текста, где један рад може имати више тема.

- Вишекласна унакрсна ентропија

У овом случају, циљне вредности су у скупу од 0 до н, односно (0, 1, 2, 3 … н). Он израчунава резултат који узима просечну разлику између стварних и предвиђених вредности вероватноће, а резултат се своди на најмању могућу тачност. Вишекласна унакрсна ентропија је задата функција за губитак проблема са класификацијом текста.

- Редка вишекласна унакрсна ентропија

Један врући поступак кодирања отежава мулти-класу унакрсне ентропије тешко баратајући се великим бројем података. Редка унакрсна ентропија решава овај проблем вршећи рачунање грешке без употребе кодирања са једним врућим.

- Дивергенцијски губитак Куллбацк Леиблер

КЛ губитак дивергенције израчунава дивергенцију између дистрибуције вероватноће и расподељене основне вредности и открива колико се информација губи у односу на битове. Излаз је негативна вредност која одређује колико су близу две дистрибуције вероватноће. Да би се описала дивергенција КЛ-а у смислу вероватноће, користи се однос вероватноће.

У овом смо чланку на почетку схватили како функционишу функције губитака, а затим смо наставили са истраживањем свеобухватне листе функција губитака помоћу примера случајева. Међутим, разумевање тога практично је корисније, зато покушајте прочитати више и имплементирати га. Темељно ће разјаснити ваше сумње.

Препоручени чланци

Ово је водич за губитке функција у машинском учењу. Овде смо расправљали о томе како функционишу функције губитка и врсте губитних функција у машинском учењу. Можда ћете такође погледати следеће чланке да бисте сазнали више -

- Методе машинског учења

- Увод у машинско учење

- Биг Дата Тецхнологиес

- Софтвер за велике податке аналитике

- Научите катогорије хиперпараметара

- Животни циклус машинског учења | Топ 8 фаза